Gli anni in cui l’euro tremò: viaggio nella crisi del debito sovrano

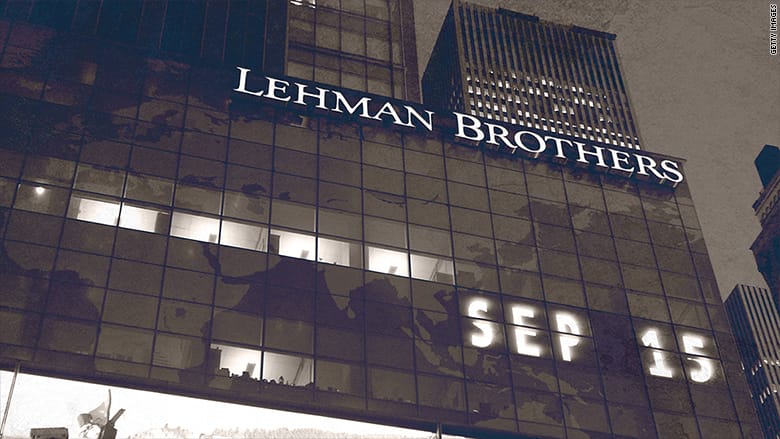

Nella memoria collettiva, la crisi dell’euro è spesso associata al 2011: lo spread BTP-Bund a 500, il governo italiano che cambia, i mercati in fibrillazione. Ma il vero punto di non ritorno è precedente: sta nel biennio 2009-2010, quando l’Europa scopre di avere costruito una moneta unica su fondamenta istituzionali incompiute.

È in quei due anni che la crisi globale dei subprime, importata attraverso il sistema bancario, si trasforma in crisi dei bilanci pubblici e, soprattutto, in crisi di fiducia verso l’architettura stessa dell’euro.

L’illusione della convergenza

Negli anni che precedono la Grande Recessione, l’euro sembra aver fatto il miracolo: i tassi sui titoli di Stato si allineano, gli spread interni all’area euro quasi scompaiono, il debito pubblico di molti Paesi scende o comunque viene finanziato a costi via via più bassi. I mercati trattano Italia, Grecia, Portogallo, Spagna e Irlanda quasi come se fossero Germania.

Quella convergenza, però, era più finanziaria che reale. Dietro la parità formale dei tassi convivono:

- Paesi con debito elevato ma struttura industriale solida;

- economie in forte crescita drogata dal credito e dall’immobiliare;

- sistemi politici abituati a usare la spesa pubblica come strumento di consenso;

- istituzioni statistiche di qualità molto diversa.

La crisi del 2008 fa saltare il velo. Il PIL dell’area euro si contrae, i cosiddetti automatic stabilizers (sussidi, spesa sociale, minori entrate) fanno esplodere i deficit, il debito pubblico compie un balzo in avanti: in media, il disavanzo dell’eurozona passa da poco più del 2% del PIL nel 2008 a oltre il 6% nel 2009, mentre il debito sale di oltre 10 punti percentuali in un solo anno.

L’impatto non è uniforme: a soffrire di più sono i Paesi che entrano nella crisi con debito elevato, crescita debole o bolle private irrisolte. È su questo terreno già indebolito che, nell’autunno 2009, si accende la miccia greca.

Autunno 2009: la verità greca e il trauma della fiducia

A ottobre il nuovo governo di Grecia annuncia che il deficit 2009 non è il 6-8% del PIL, come raccontato fino ad allora, ma il doppio. Le successive revisioni di Eurostat fisseranno il dato al 15,4% del PIL, con un rapporto debito/PIL rivisto verso l’alto oltre il 120%.

Per i mercati è un tradimento. Non è solo il numero in sé, è la scoperta che per anni i conti sono stati abbelliti con artifici contabili e derivati off-balance. Se è successo con Atene, chi garantisce che altri Stati non abbiano fatto qualcosa di simile?

Nel giro di poche settimane, i rendimenti dei titoli greci esplodono: lo spread contro il Bund triplica, poi continua a correre. Quello che fino a poco tempo prima era un “debito quasi tedesco” diventa improvvisamente high yield. E, soprattutto, si insinua nei desk di tutto il mondo la domanda che nessuno osava formulare: l’euro è veramente irreversibile?

Dal caso Grecia alla crisi dell’euro

Il contagio non è immediato, ma è rapido. Gli investitori iniziano a scorrere l’elenco dei Paesi con:

- debito elevato e crescita modesta,

- forte esposizione bancaria verso l’immobiliare,

- conti esterni fragili.

Nel mirino entrano Portogallo, Irlanda, Spagna e — più in filigrana, ma in modo crescente — l’Italia.

È in questa fase che si manifesta con chiarezza il doom loop banche-Stato: gli istituti di credito nazionali sono carichi di titoli pubblici domestici; quando il prezzo di quei titoli scende e i rendimenti salgono, il capitale delle banche si assottiglia. Per salvare le banche serve lo Stato, ma questo significa più debito e, quindi, ulteriori pressioni sui titoli sovrani. Un circuito chiuso che trasforma un problema di liquidità in un rischio di solvibilità.

Cosa prezzava il mercato (e cosa ha sbagliato a prezzare)

Nel biennio 2009-2010 i mercati iniziano a prezzare scenari che, fino a poco prima, sarebbero stati classificati come fantafinanza. Nei CDS e negli spread si leggono tre timori principali:

- l’ipotesi di default sovrano non più circoscritta a Paesi “emergenti”, ma pienamente europea;

- il rischio di una frammentazione irreversibile dell’area euro tra “core” e “periferia”;

- il dubbio che non esista alcun soggetto, in Europa, disposto a svolgere il ruolo di prestatore di ultima istanza per gli Stati.

La Grecia è ormai trattata come insolvente di fatto; l’Irlanda vede i rendimenti salire verso il 9% sul decennale; il Portogallo scivola rapidamente in area 300-400 punti base di spread; la Spagna, nonostante un debito pubblico relativamente contenuto, paga il conto dell’enorme bolla immobiliare; l’Italia, pur tenendo in quel momento uno spread più contenuto, inizia a essere citata nelle analisi di rischio come “too big to bail, but too big to fail”.

Questa reazione ha una parte razionale e una parte eccessiva. Razionale, perché l’euro nasce senza strumenti né regole per gestire una crisi di solvibilità interna: niente fondo di salvataggio, niente unione bancaria, nessun OMT all’orizzonte. Eccessiva, perché il mercato sottovaluta la capacità — e l’interesse vitale — delle istituzioni europee a difendere la moneta unica, anche al costo di cambiare in corsa le regole del gioco.

In altre parole: gli operatori hanno valutato correttamente la fragilità immediata, ma non hanno prezzato fino in fondo la futura risposta politica, che si manifesterà nei mesi e negli anni successivi.

2010: l’Europa impara a fare politica economica in tempo reale

Se il 2009 è l’anno dello shock, il 2010 è l’anno delle risposte, spesso esitanti, talvolta contraddittorie, ma progressivamente più strutturate.

Nei primi mesi, l’Unione vive una sorta di paralisi: la discussione pubblica oscilla tra chi invoca la disciplina fiscale a oltranza e chi chiede meccanismi di solidarietà finanziaria; i Paesi del Nord temono il moral hazard, quelli del Sud denunciano il rischio di una nuova stagione di austerità pro-ciclica imposta dall’esterno.

La svolta arriva a maggio. Nel giro di un fine settimana, sotto la pressione di mercati sempre più nervosi, i ministri delle Finanze e i capi di Stato varano lo European Financial Stability Facility (EFSF), un veicolo capace di emettere debito garantito in solido dagli Stati membri per finanziare Paesi in difficoltà, e la Banca Centrale Europea annuncia il Securities Markets Programme, con cui si riserva la possibilità di acquistare titoli di Stato sul mercato secondario per “ristabilire il corretto funzionamento del meccanismo di trasmissione della politica monetaria”.

Nello stesso mese viene approvato il primo pacchetto di aiuti alla Grecia, circa 110 miliardi fra fondi europei e Fondo Monetario Internazionale, in cambio di durissime misure di consolidamento fiscale e riforme strutturali.

È la nascita della Troika e l’ingresso, di fatto, di Atene in una forma di commissariamento finanziario. Nel frattempo gli occhi del mercato si spostano su Dublino.

Irlanda: quando le banche cannibalizzano lo Stato

L’Irlanda entra nell’euro come “tigre celtica”, simbolo di crescita, attrazione di capitali e bolla immobiliare. La crisi globale manda in frantumi il modello basato sull’espansione del credito e, nel 2008, il governo sceglie di garantire in modo praticamente illimitato le passività bancarie.

È una scelta che nel 2010 presenta il conto. Man mano che emerge l’ammontare reale delle perdite del sistema bancario, il deficit pubblico viene aggiornato a livelli senza precedenti: includendo i costi di ricapitalizzazione, arriva al 32% del PIL, dieci volte il limite del Patto di Stabilità.

A novembre 2010, con i rendimenti sui titoli di Stato che sfiorano il 9% e l’accesso ai mercati sostanzialmente compromesso, Dublino chiede formalmente assistenza a UE e FMI. Anche qui, i mercati avevano prezzato una crisi bancaria; ciò che non avevano anticipato appieno era la scelta politica di trasformarla in crisi sovrana attraverso la garanzia generalizzata.

Portogallo, Spagna, Italia: le faglie che si aprono

Nel frattempo, il Portogallo scivola lentamente ma inesorabilmente verso la perdita di accesso ai mercati, stretto tra crescita anemica, debito in aumento e deficit persistenti; la richiesta di aiuto arriverà nel 2011, ma nel 2010 gli investitori hanno già iniziato ad alzare in modo significativo il premio per il rischio.

La Spagna vive una crisi diversa: è l’esplosione di una gigantesca bolla immobiliare, con un sistema di cajas regionali sovraesposto ai mutui e ai finanziamenti al settore edilizio. Il debito pubblico parte da livelli relativamente bassi, ma il mercato sa che nessun governo può permettersi un collasso disordinato del sistema bancario domestico.

L’Italia, infine, non è ancora epicentro, ma entra nella mappa mentale del rischio. Il debito è alto, la crescita potenziale modesta, la politica appare poco reattiva. Nel 2010 lo spread rimane lontano dai livelli greci o irlandesi, ma per la prima volta dopo l’ingresso nell’euro il Paese viene inserito stabilmente nel gruppo delle economie “periferiche”.

2009-2010 come spartiacque istituzionale

Guardato con il senno di prima, il biennio 2009-2010 è un gigantesco stress test in cui l’Europa scopre tre cose, tutte decisive.

La prima: un’unione monetaria senza strumenti di gestione delle crisi fiscali è intrinsecamente instabile. L’idea che la sola disciplina di mercato e il Patto di Stabilità bastassero a prevenire derive pericolose si dimostra illusoria.

La seconda: i mercati, in assenza di un prestatore di ultima istanza esplicito per i titoli sovrani, possono innescare spirali auto-avveranti di sfiducia, indipendentemente dai fondamentali di medio periodo.

La terza: l’unica alternativa praticabile alla dissoluzione dell’euro è un’evoluzione istituzionale, non solo tecnica. Da quel momento in poi prenderanno forma l’ESM permanente, l’unione bancaria, gli strumenti di backstop condizionato sui mercati dei titoli di Stato, fino al “whatever it takes” di Draghi nel 2012 e, anni dopo, alle prime forme di debito comune europeo.

Il lascito per gli investitori

Per chi guarda ai mercati obbligazionari con prospettiva di lungo periodo, la lezione del 2009-2010 è duplice.

Da un lato, ricorda che il rischio sovrano non è mai solo una frazione debito/PIL o un deficit annuale: è un equilibrio dinamico fra sostenibilità economica, credibilità politica e qualità istituzionale.

Dall’altro, mostra che nelle unioni monetarie incompiute il vero rischio di portafoglio è l’incertezza sulle regole del gioco: chi paga in caso di crisi, con quali strumenti, con quali condizioni e con quale grado di condivisione tra Paesi.

In quella fase i mercati hanno prezzato con una certa lucidità le fragilità immediate di Grecia, Irlanda e Portogallo, ma hanno sottovalutato l’incentivo esistenziale a difendere l’euro anche a costo di trasformarlo, passo dopo passo, in qualcosa di più simile a un progetto politico che a una semplice area valutaria.

Il risultato è che la crisi del debito sovrano europeo non è stata solo una crisi di contabilità pubblica. È stata, prima di tutto, una gigantesca negoziazione sul futuro dell’euro. E quella negoziazione, cominciata fra il 2009 e il 2010 sotto la pressione dei mercati, continua tuttora, ogni volta che si discute di regole fiscali, di condivisione del rischio o di che cosa significhi davvero essere, in Europa, “uniti nella diversità”.